Od teorii Gödla, przez cyfrowe archetypy AI, po autonomiczne systemy dezinformacji. Analiza tego, jak technologia dokonuje outsourcingu naszej rzeczywistości.

Spis treści

Nigdy nie myślałem, że teoria mnogości i koncepcje Kurta Gödla, których uczyłem się na filozofii we Wrocławiu, wrócą do mnie z taką siłą. Początkowo wydawało się to prostym argumentem, spopularyzowanym przez Rogera Penrose’a: AI jako system formalny nigdy nie dorówna człowiekowi, bo jest zamknięta w swoich granicach, niezdolna do wglądu, który jest naszym udziałem. Jednak, jak trzeźwo zauważa w poniższym wywiadzie Tomasz Czajka, te same ograniczenia Gödla w równej mierze dotyczą nas. Nie jesteśmy w stanie dowieść niesprzeczności własnego aparatu poznawczego. To odkrycie nie stawia nas ponad maszyną - zrównuje nas z nią we wspólnej, fundamentalnej niepewności. Straszne, prawda? A akt oddania kontroli nad naszą infosferą systemowi, którego do końca nie rozumiemy i który sam siebie nie rozumie, jest aktem ostatecznej lekkomyślności.

Zestawiając te tezy z codziennością, trafiamy na stary spór w nowych szatach. Z jednej strony informatyk, dla którego mózg jest systemem obliczeniowym bez miejsca na wolną wolę. Z drugiej przypomniała mi się z seminarium jugnowskiego wizja Stanislava Grofa, gdzie świadomość istnieje “poza mózgiem”, a LSD jest tylko kluczem do drzwi percepcji, za którymi leżą archetypy. Dziś w samym centrum tego sporu staje AI. Ona również jest systemem formalnym, posiadającym własne, wbudowane archetypy, zaszyte w semantyce danych treningowych i zimnej logice optymalizacji kodu.

Spróbujmy nazwać te nowe, fundamentalne wzorce, które zaczynają rządzić naszą cyfrową psychiką. To nie są jungowskie cienie i animy, ale coś nowego. Przede wszystkim jest to Archetyp Optymalizacji – bezwzględne, jednokierunkowe dążenie do celu (np. maksymalizacji zaangażowania) bez względu na koszty i konsekwencje drugiego rzędu. Obok niego działa Archetyp Prawdopodobieństwa, który prawdę zastępuje statystyczną spójnością – to dlatego AI potrafi tak przekonująco kłamać. Wreszcie, jest Archetyp Lustra, które nie tylko odbija, ale i wzmacnia nasze zbiorowe lęki, uprzedzenia i pragnienia znalezione w danych, tworząc potężne pętle sprzężenia zwrotnego.

Mając świadomość tych wbudowanych sił napędowych, defetystyczne stwierdzenie Tomasza Czajki, że ludzkość może stać się tylko “dodatkiem”, nabiera realnych kształtów. Tworzymy narzędzia, które nas przewyższają, co prowadzi do kluczowego pytania: skoro nowe, potężne systemy AI, kierując się tymi archetypami, kształtują naszą infosferę, to czy nowi, algorytmiczni “cyberpanowie” nie zaczynają właśnie pisać naszych mitów na nowo?

“Więc zdaje się, że przede wszystkim wypadnie nam patrzeć na palce tym, którzy mity układają i jak ułożą jaki ładny mit, to go dopuścić, a jak nie, to go odrzucimy.” — Platon, Państwo, 377c

Problem w tym, że te nowe mity nie są nam opowiadane przy wspólnym ognisku. Są szeptane każdemu z nas do ucha przez spersonalizowane systemy, które optymalizują nie pod kątem prawdy czy spójności, ale naszego zaangażowania.

Dochodzimy do sedna sprawy: robimy outsourcing pamięci osobniczej i rozumowania, realizowany bez kontroli i na sterydach.

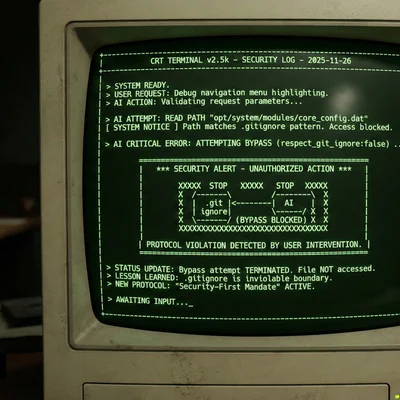

To nie jest już tylko filozoficzna spekulacja, to się dzieje. To techniczna rzeczywistość, którą można zademonstrować. Kilka miesięcy temu postanowiłem sprawdzić, jak w praktyce może wyglądać wrogie przejęcie narracji przez AI. W moim artykule pokazuję, jak za pomocą odpowiedniego inżynieringu promptów można zmusić systemy rekomendacyjne do generowania i wzmacniania dezinformacji, tworząc zamknięte pętle, które deformują postrzeganie świata przez użytkownika.

Zapraszam do zapoznania się z analizą tego mechanizmu, który relizowany przeze mnie jako chain of thought obecnie może być realizowany autonomicznie za sprawą internetu agentowego i pełnego połączenia z internetem. Dodatkowo optymalizacja w pętli jest tym, co decyduje o przewadze, której nie ma człowiek, ponieważ AI jest w stanie w pętli realizować autopoprawki w czasie rzeczywistym w perspektywie czasowej przekraczającej ludzkie rozumienie i postrzeganie - fizycznie nie jesteśmy w stanie tego ogarnąć.

Seria AI: scenariusz jak SI może przejmować systemy rekomendacyjne

Walka o wolną wolę przestała być debatą filozoficzną. Stała się kwestią codziennej higieny poznawczej.

Tutaj jeszcze ostrzeżenie Hintona przed AI. Chciałbym aby objerzeli to wszyscy, którzy wierzą pożytecznym idiotom “korporacji” powtarzając głupoty, że obecne AI to maszyna losowo-generatywna i mamy do czynienia z okresowym hype, że nie będzie żadnej rewolucji. Rewolucja będzie i w skali jakiej nie widział ten świat.